AI-regulering in Europa

In april 2021 stelde de Europese Commissie de eerste EU-wetgeving rond artificiële intelligentie, waarbij een classificatiesysteem op basis van risico werd ingevoerd.

AI-systemen die voor verschillende toepassingen kunnen worden ingezet, worden geanalyseerd en ingedeeld volgens het risico dat ze inhouden voor de gebruikers. De verschillende risiconiveaus bepalen of er meer dan wel minder nalevingsvereisten (compliance) van kracht zijn.

Wat het Parlement wou in de AI-wetgeving

De prioriteit van het Parlement was om ervoor te zorgen dat AI-systemen die in de EU worden gebruikt veilig, transparant, traceerbaar, niet-discriminerend en milieuvriendelijk zijn. AI-systemen zouden door mensen moeten worden gecontroleerd, eerder dan door automatisering, om schadelijke gevolgen te voorkomen.

Het Parlement wou ook een technologieneutrale, uniforme definitie voor AI vastleggen die op toekomstige AI-systemen kan worden toegepast.

AI-verordening

Verschillende regels volgens het risiconiveau

De nieuwe regels leggen verplichtingen op aan aanbieders en gebruikers, afhankelijk van het risiconiveau dat aan de AI-toepassing wordt toegekend. Hoewel veel systemen slechts een minimaal risico inhouden, moeten ze toch allemaal beoordeeld worden.

Onaanvaardbaar risico

Bepaalde AI-toepassingen zijn in de EU verboden, waaronder

01

Cognitieve gedragsmanipulatie van mensen of specifieke kwetsbare groepen (bijvoorbeeld speelgoed met spraakherkenning dat gevaarlijk gedrag bij kinderen aanmoedigt).

02

Social scoring via AI het klasseren van mensen op basis van gedrag, sociaaleconomische status of persoonlijke kenmerken.

03

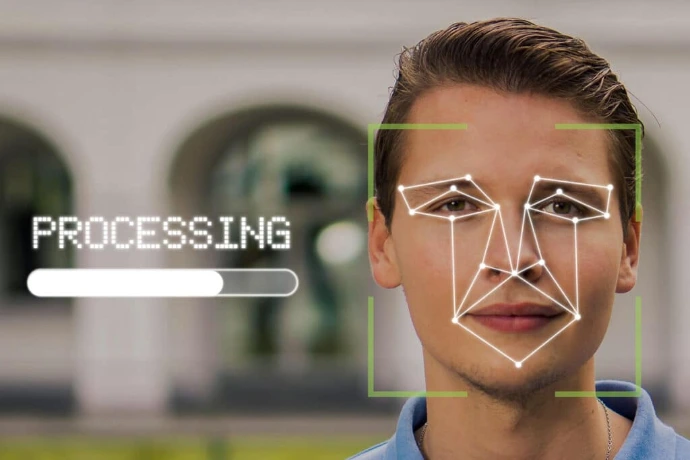

Biometrische identificatie en categorisering van personen.

04

Realtime-identificatiesystemen op afstand, zoals gezichtsherkenning in de publieke ruimte.

Voor wetshandhaving kunnen uitzonderingen worden toegestaan. "Realtime" biometrische identificatie op afstand wordt enkel toegestaan in een beperkt aantal ernstige gevallen. "Post"-identificatie (waarbij de identificatie pas na een aanzienlijke vertraging gebeurt) mag enkel gebruikt worden voor de vervolging van zware misdrijven en na toestemming van de rechter.

Hoog risico

AI-systemen die een negatieve impact hebben op de veiligheid of de grondrechten, worden als "hoog risico" beschouwd. Ze worden onderverdeeld in twee categorieën:

Systemen in producten

die onder de EU-wetgeving voor productveiligheid vallen (zoals speelgoed, luchtvaart, auto's, medische hulpmiddelen en liften).

Systemen op specifieke domeinen

die geregistreerd moeten worden in een EU-databank:

Beheer van kritieke infrastructuur.

Onderwijs en beroepsopleiding.

Werkgelegenheid, personeelsbeheer en toegang tot zelfstandige arbeid.

Toegang tot essentiële private en publieke diensten (bijv. sociale voorzieningen).

Handhaving van de wet.

Migratie, asiel en grenscontrole.

Ondersteuning bij juridische interpretatie en de toepassing van de wet.

Alle AI-systemen met een hoog risico worden zowel voor het op de markt brengen als gedurende hun volledige levenscyclus gecontroleerd. Burgers krijgen het recht om klacht in te dienen over AI-systemen bij de bevoegde nationale autoriteiten.

Transparantievereisten

Generatieve AI, zoals ChatGPT, wordt niet automatisch als "hoog risico" geklasseerd, maar moet wel voldoen aan transparantievereisten en de Europese auteursrechtwetgeving:

Openbaar

Openbaar maken dat de inhoud door AI is gegenereerd.

Safe

Het model zo ontwerpen dat het geen illegale inhoud kan aanmaken.

Auteursrecht

Samenvattingen publiceren van auteursrechtelijk beschermde gegevens die gebruikt zijn voor de training.

AI-modellen voor algemene doeleinden met een grote impact die een systeemrisico kunnen inhouden (zoals de meer geavanceerde modellen zoals GPT-4), moeten grondig geëvalueerd worden. Ernstige incidenten moeten gemeld worden aan de Europese Commissie.

Inhoud die gemaakt of aangepast is met hulp van AI; zoals afbeeldingen, audio of video (bijvoorbeeld deepfakes) moet duidelijk gelabeld worden als "door AI gegenereerd", zodat gebruikers dit meteen doorhebben.

EPRS – European Parliamentary Research Service. © Europese Unie, 2024.